У сучасній науці обсяг даних зростає швидше, ніж здатність багатьох дослідників їх ефективно обробляти. Великі масиви інформації стали невід'ємною частиною досліджень у медицині, соціальних науках, освіті та навіть гуманітаристиці. Проте традиційно якісний аналіз даних асоціюється зі знанням мов програмування, таких як Python або R, що часто стає...

Дані без коду: як науковцю аналізувати великі масиви

У сучасній науці обсяг даних зростає швидше, ніж здатність багатьох дослідників їх ефективно обробляти. Великі масиви інформації стали невід'ємною частиною досліджень у медицині, соціальних науках, освіті та навіть гуманітаристиці. Проте традиційно якісний аналіз даних асоціюється зі знанням мов програмування, таких як Python або R, що часто стає бар'єром для значної частини науковців. Саме тут на допомогу приходять low-code інструменти - рішення, які дозволяють працювати з даними без глибоких технічних навичок. Завдяки інтуїтивно зрозумілим інтерфейсам, візуальним моделям та автоматизованим алгоритмам, вони відкривають доступ до складної аналітики навіть для тих, хто раніше не мав досвіду програмування.

У цій статті розглянемо, як саме low-code підхід змінює наукову діяльність, які інструменти варто використовувати та як ефективно застосовувати їх у роботі з великими масивами даних.

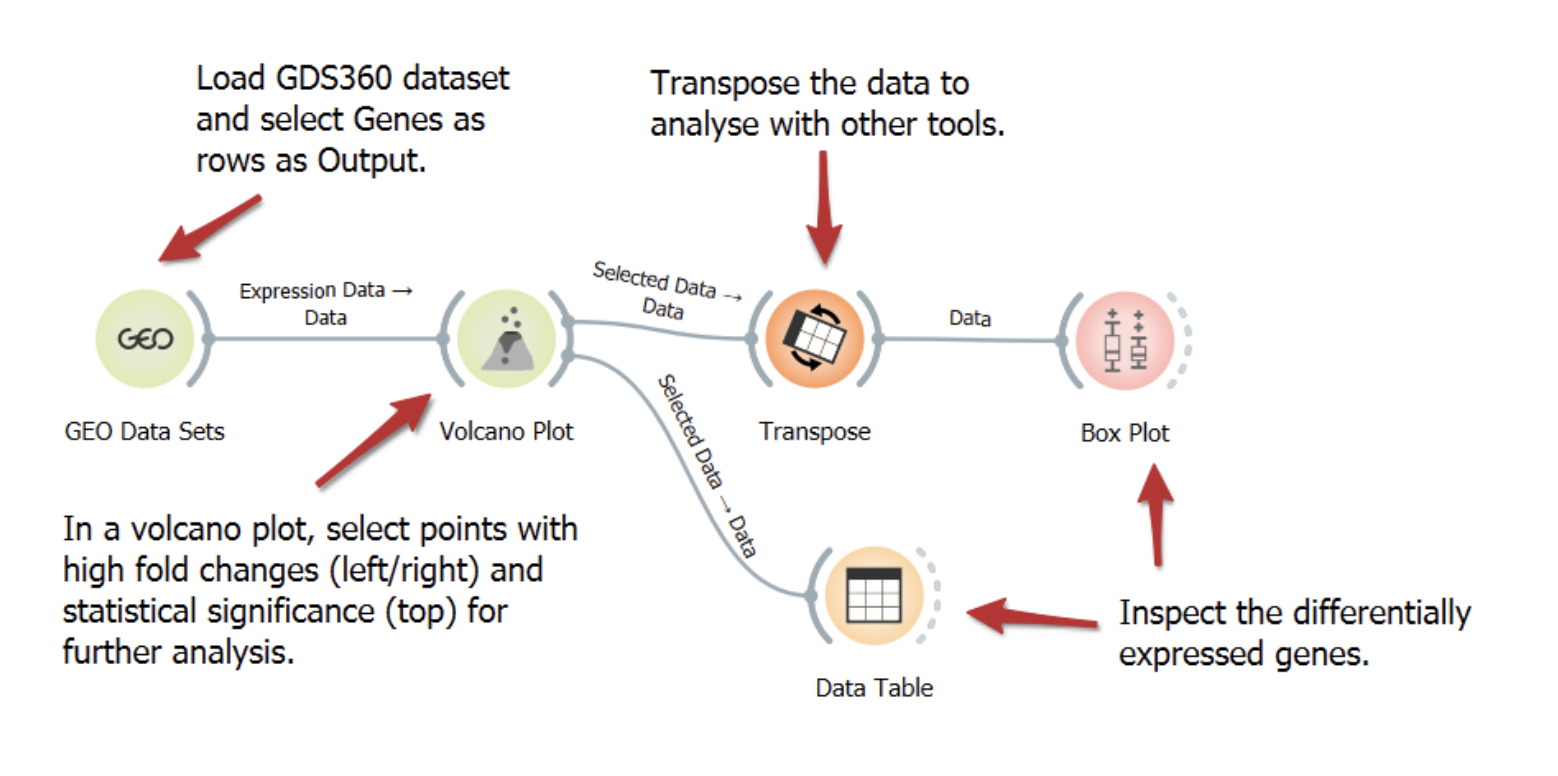

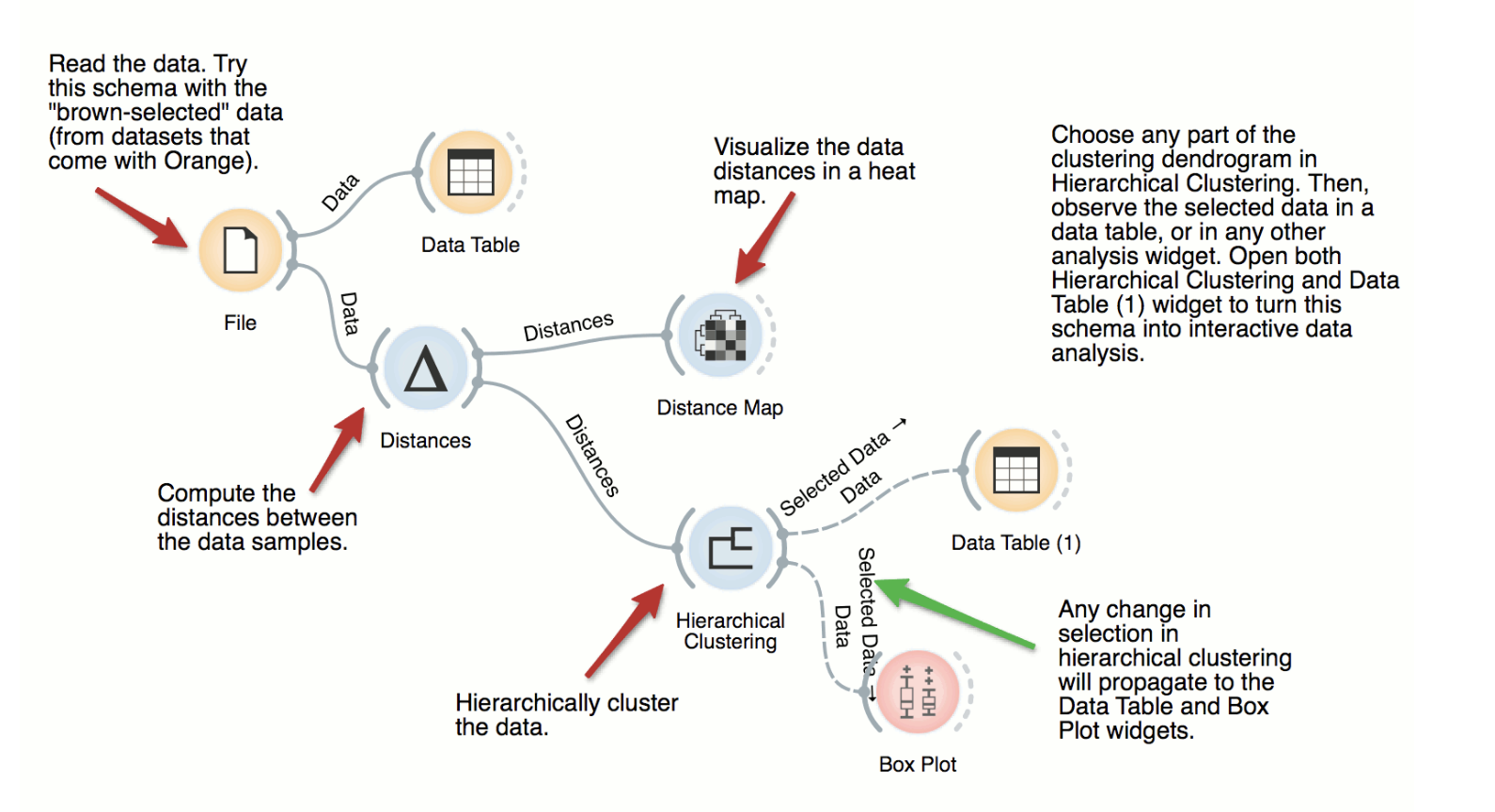

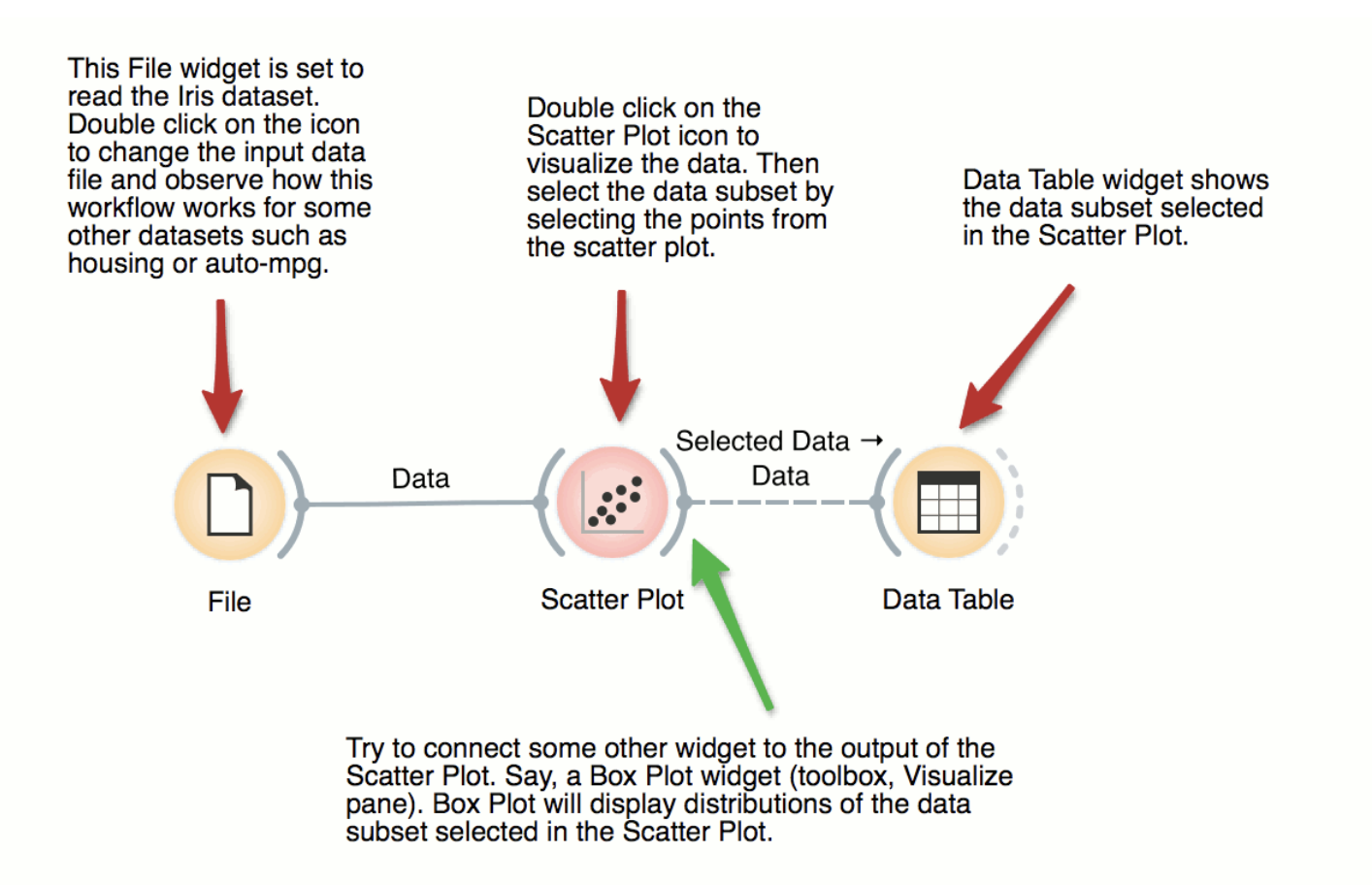

Більшість науковців звикли до таблиць, де кожна маніпуляція з даними робиться вручну. Але для великих масивів цей шлях веде до помилок. На зміну приходить концепція Visual Programming - замість написання коду ви будуєте "схему" (workflow) з готових блоків.

Переваги такого підходу:

Відтворюваність: Ви один раз створюєте ланцюжок дій, і він автоматично працює для будь-якої кількості нових даних.

Прозорість: кожен крок обробки (очищення, фільтрація, аналіз) візуально зафіксований.

ТОП-3 інструменти для аналізу без коду

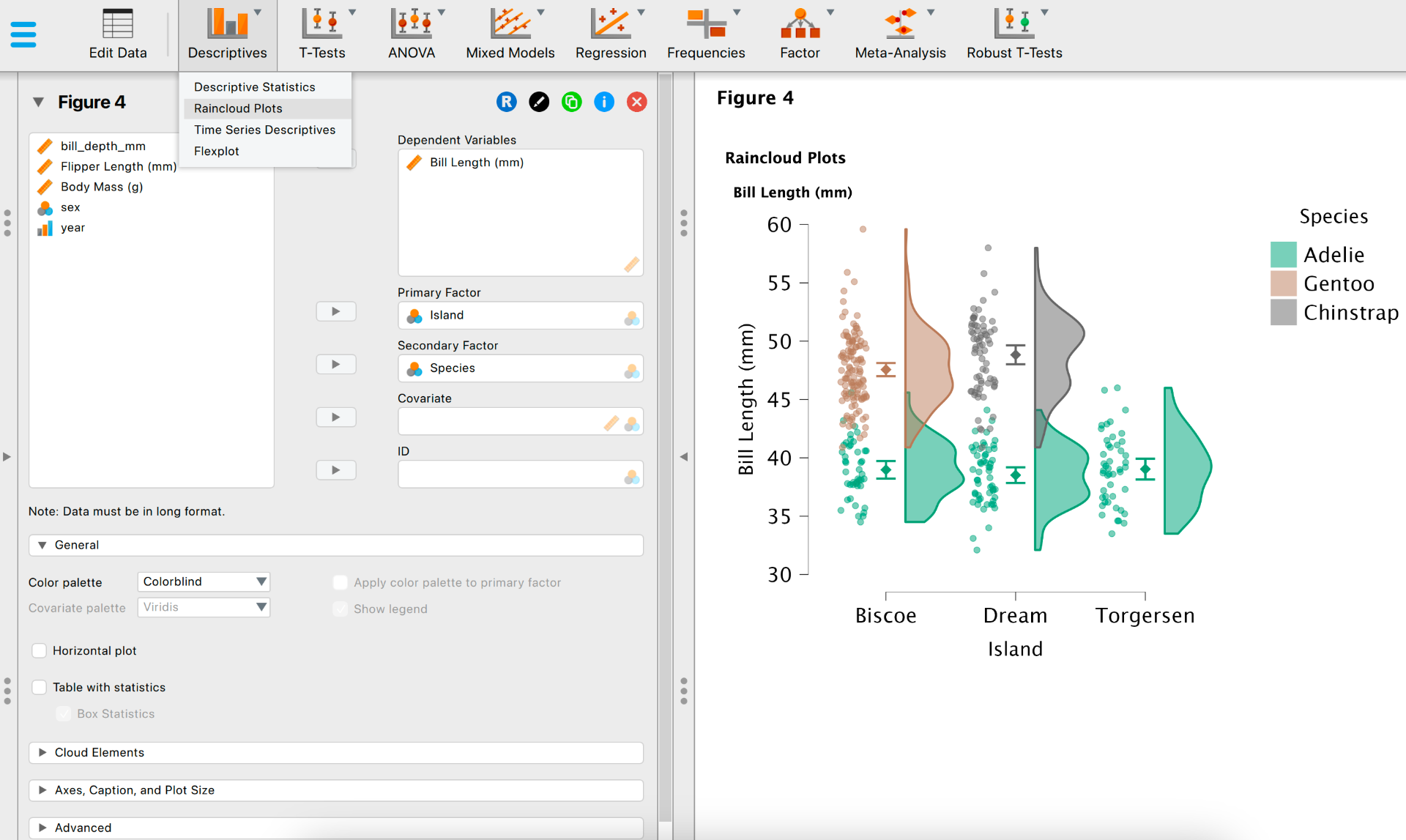

Orange Data Mining: інтерактивність та простота - це, мабуть, найбільш дружній інструмент для науковця. Програма має вигляд полотна, на яке ви перетягуєте «віджети».

Для кого: медики, біологи, соціологи.

Що вміє: кластеризація (поділ об'єктів на групи), аналіз текстів (NLP), побудова дерев рішень та теплових карт.

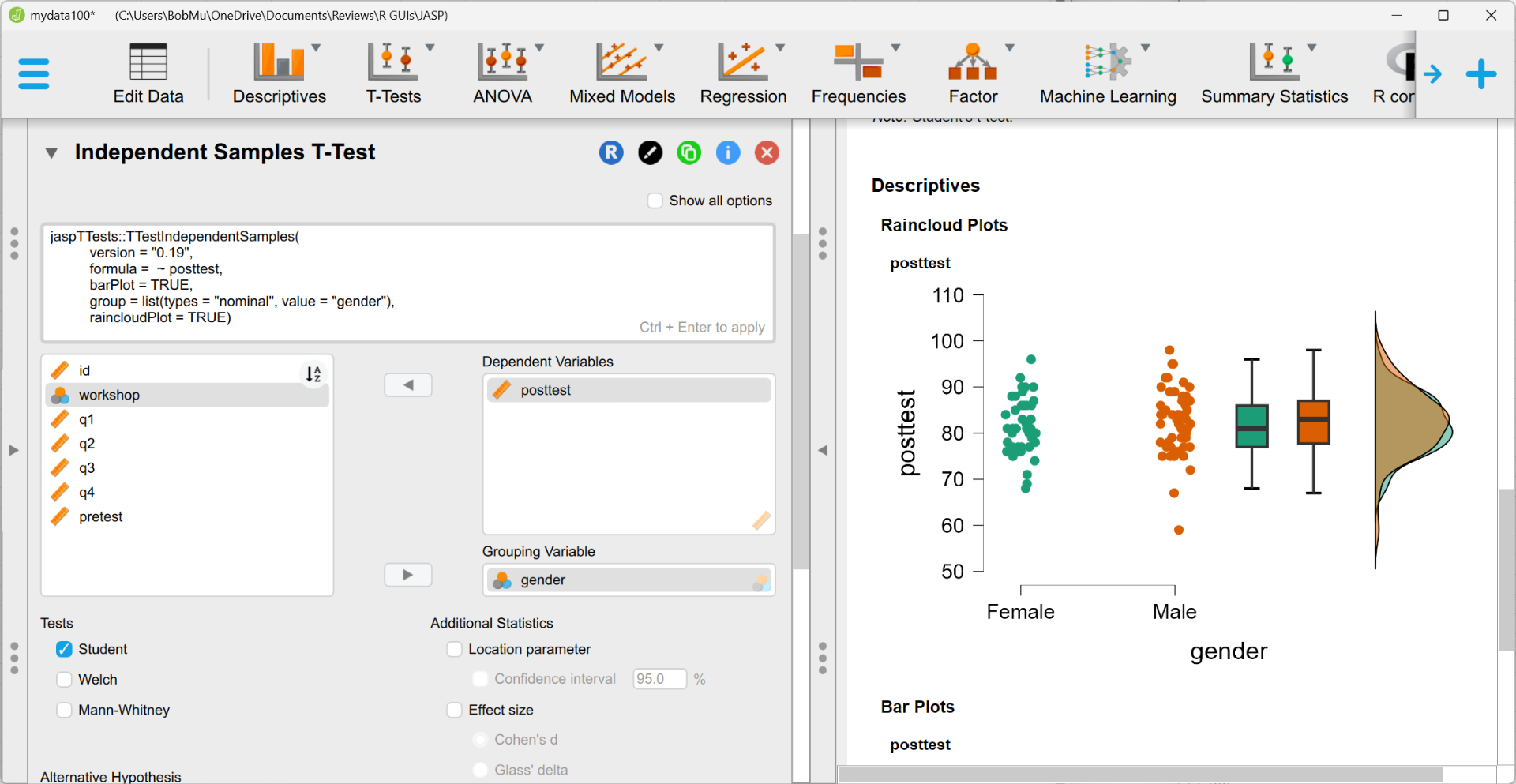

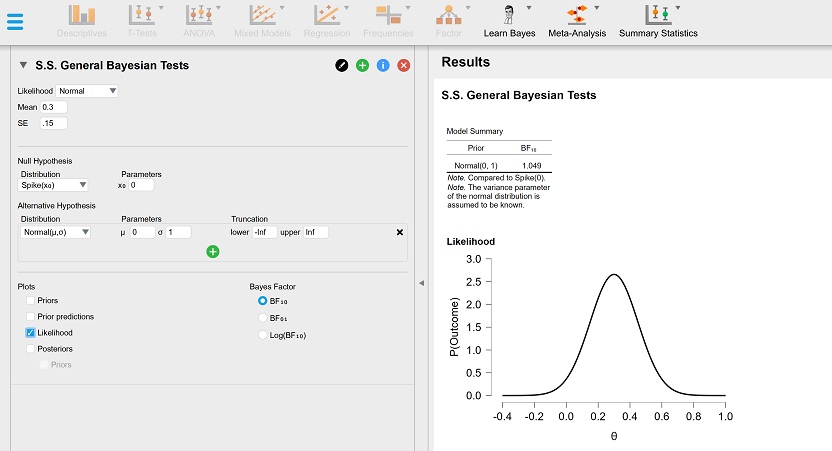

JASP: безкоштовна альтернатива SPSS. Якщо ваша мета - чиста статистика та перевірка гіпотез (t-тести, ANOVA, регресія), JASP є ідеальним вибором.

Фішка: програма орієнтована на стандарти публікації у журналах Scopus та Web of Science - таблиці результатів одразу відповідають вимогам APA style.

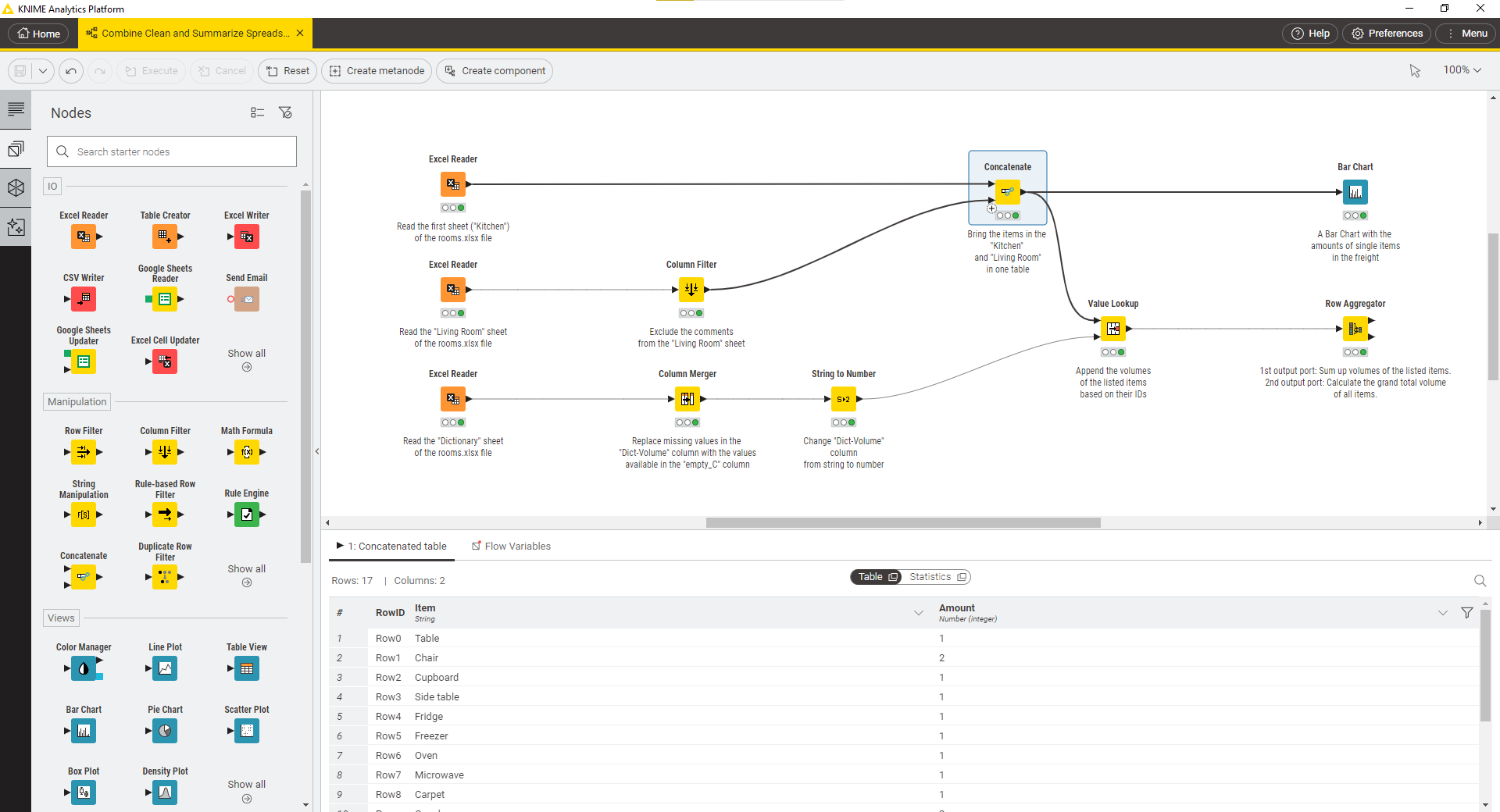

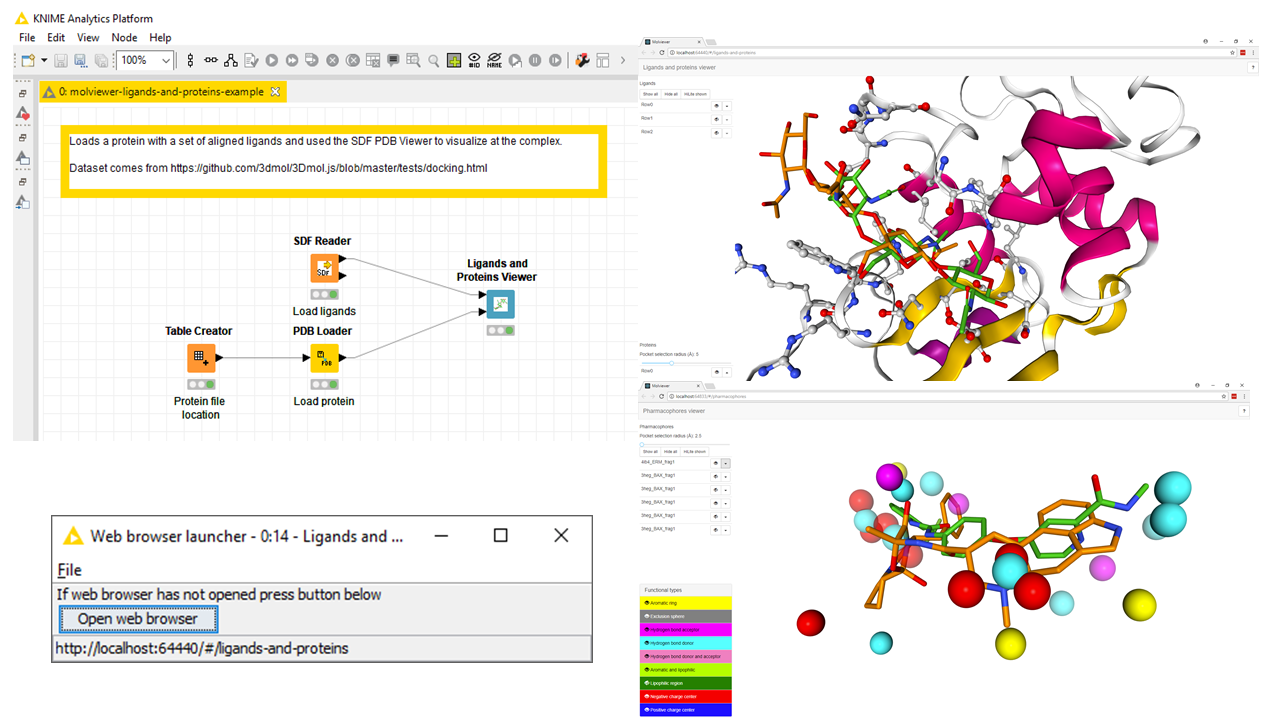

KNIME Analytics Platform: потужність для великих проєктів - більш серйозний інструмент для тих, хто працює з гігантськими базами даних або потребує глибокої інтеграції з різними джерелами.

Можливості: автоматизація збору даних з вебсайтів, складна передобробка «брудних» даних, базове машинне навчання.

Low-code інструменти дозволяють закривати широкий спектр дослідницьких задач:

- обробка та очищення даних (видалення дублікатів, пропущених значень);

- описова статистика та базовий аналіз;

- побудова графіків і дашбордів;

- кластеризація та сегментація даних;

- прогнозування на основі готових моделей;

- аналіз текстових даних (наприклад, наукових публікацій або анкет).

Це означає, що навіть без знання мов програмування дослідник може проводити повноцінний емпіричний аналіз.

Переваги low-code підходу в науці

Використання low-code інструментів у науковій діяльності відкриває нові можливості для дослідників, особливо тих, хто не має технічної підготовки у програмуванні. Розглянемо ключові переваги більш детально.

1. Доступність для широкого кола науковців - Low-code рішення суттєво знижують поріг входу в аналіз даних. Якщо раніше для обробки навіть базових масивів інформації потрібно було вивчати Python або R, то сьогодні достатньо розуміти логіку дослідження та базові принципи роботи з даними.

2. Економія часу та ресурсів - створення аналітичних моделей або навіть простих статистичних розрахунків у класичних мовах програмування може займати значний час. Low-code інструменти дозволяють автоматизувати рутинні процеси - від очищення даних до побудови візуалізацій.

3. Інтуїтивна візуалізація процесів - більшість low-code платформ працюють за принципом візуальних блоків або workflow-схем. Це означає, що кожен етап аналізу - від завантаження даних до отримання результатів - є наочним і зрозумілим. Такий підхід не лише спрощує роботу, а й допомагає краще контролювати дослідницький процес і уникати логічних помилок.

4. Зменшення кількості технічних помилок - при роботі з кодом навіть незначна синтаксична помилка може призвести до некоректних результатів або повного збою аналізу. Low-code інструменти мінімізують такі ризики, оскільки більшість операцій вже реалізовані у вигляді готових модулів.

5. Підвищення автономності дослідника - науковці отримують можливість самостійно проводити аналіз без залучення програмістів або аналітиків даних. Це особливо актуально в умовах обмежених ресурсів або дедлайнів. Крім того, дослідник краще розуміє власні дані та процес їх обробки, що позитивно впливає на якість інтерпретації результатів.

6. Швидке навчання та впровадження - освоєння більшості low-code платформ займає значно менше часу, ніж вивчення мов програмування. Часто достатньо кількох днів або тижнів практики, щоб почати впевнено використовувати інструмент у власних дослідженнях. Це дозволяє швидко інтегрувати аналітику даних у повсякденну наукову діяльність.

7. Гнучкість у вирішенні типових задач - хоча low-code інструменти мають певні обмеження, для більшості стандартних дослідницьких завдань їх функціоналу цілком достатньо. Вони дозволяють виконувати статистичний аналіз, сегментацію, візуалізацію та навіть базове машинне навчання без необхідності глибоких технічних знань.

Алгоритм роботи: від «сирих» даних до результату

Незалежно від обраної програми, процес аналізу без коду завжди складається з чотирьох кроків:

Імпорт (Data Loading): завантаження вашого файлу (CSV, Excel) у середовище.

Очищення (Data Cleaning): автоматичне видалення дублікатів, заповнення пропущених значень або фільтрація аномалій.

Моделювання (Processing): вибір алгоритму (наприклад, кореляційний аналіз або пошук закономірностей).

Візуалізація (Communication): перетворення цифр у графіки, які «говорять» самі за себе.

Сьогодні рецензенти топових журналів часто просять надати дані (Open Data) та опис методології їх обробки. Використання вищезгаданих інструментів дозволяє вам:

Додати до статті схему вашого аналітичного процесу.

Гарантувати, що ваші розрахунки можна перевірити.

Використовувати сучасні методи машинного навчання, що значно підвищує науковий рівень публікації.

У сучасних умовах стрімкого зростання обсягів даних здатність ефективно їх аналізувати стає однією з ключових компетенцій науковця. Водночас вимога володіння мовами програмування більше не є єдиним шляхом до якісної аналітики. Low-code інструменти відкривають нові можливості для дослідників, дозволяючи працювати з великими масивами даних швидко, зручно та без глибоких технічних знань. Їх використання сприяє демократизації науки - аналітичні можливості стають доступними ширшому колу фахівців, незалежно від їхнього технічного бекграунду. Це особливо важливо для гуманітаріїв, медиків та освітян, які можуть самостійно проводити дослідження, перевіряти гіпотези та отримувати практично значущі результати.

Отже, впровадження low-code інструментів у наукову практику - це не лише про зручність, а й про підвищення ефективності, автономності та якості досліджень у цілому. Це крок до сучасної науки, де головну роль відіграє не технічна складність, а здатність працювати з даними та робити обґрунтовані висновки.

З повагою, команда АкадемПростір!

Замовте наші послуги

Будь ласка, заповніть деталі форми і ми зв'яжемося з вами якнайшвидше.

Останні статті в блозі

У сучасному академічному середовищі швидкість поширення знань стає не менш важливою, ніж їх якість. Традиційний процес наукового рецензування, попри свою надійність, часто займає місяці, а інколи й роки. У відповідь на цей виклик дедалі більшої популярності набувають препринти - попередні версії наукових статей, які публікуються до проходження...

У сучасній науковій практиці систематичні огляди відіграють важливу роль в узагальненні результатів досліджень, формуванні доказової бази та прийнятті обґрунтованих рішень у різних галузях знань - від медицини до соціальних наук. Проте якість такого огляду значною мірою залежить від прозорості методології, чіткості опису етапів дослідження та...

У сучасному академічному середовищі цифрова присутність науковця стала невід'ємною частиною професійної діяльності. Профілі в наукометричних базах, дослідницьких платформах та академічних мережах використовуються для ідентифікації автора, відстеження цитувань, пошуку наукових партнерів і підтвердження наукових досягнень. Водночас разом із розвитком...